Sztuczna inteligencja przyniosła niespotykany wcześniej rozwój technologiczny, ale jednocześnie otworzyła drzwi dla nowej generacji cyberprzestępców. Szczególnie niebezpieczne okazują się technologie klonowania głosu i deepfake'ów, które w 2025 roku stały się głównym narzędziem oszustów na całym świecie. Badanie McAfee z 2024 roku wykazało, że jeden na czterech dorosłych doświadczył oszustwa z wykorzystaniem sklonowanego głosu AI, a globalne straty spowodowane tego typu atakami osiągnęły już 40 miliardów dolarów rocznie. Metody działania przestępców stały się na tyle wyrafinowane, że nawet świadomi użytkownicy często nie potrafią odróżnić prawdziwego głosu od sztucznego.

Spis treści:

Jak działa klonowanie głosu – technologia dostępna dla każdego

Współczesne narzędzia do klonowania głosu są przerażająco proste w obsłudze i powszechnie dostępne. Do stworzenia przekonującego deepfake'u głosowego wystarczy zaledwie kilkanaście sekund nagrania z TikToka, YouTube'a czy Instagram Stories. Algorytmy sztucznej inteligencji analizują próbki mowy, ucząc się charakterystycznych cech głosu, takich jak ton, akcent, tempo czy modulacja. W efekcie powstaje cyfrowy klon, który potrafi wypowiedzieć dowolny tekst głosem obranego targetu. Co więcej, większość platform oferujących klonowanie głosu nie wymaga żadnych mechanizmów weryfikacji zgody osoby, której głos jest klonowany.

Cztery z sześciu najpopularniejszych serwisów pozwalają na bezpłatne stworzenie własnego klonu głosowego bez jakichkolwiek zabezpieczeń. Przestępcy wykorzystują też zaawansowane systemy takie jak ElevenLabs czy Resemble AI, które oferują niemal perfekcyjną jakość syntezy mowy. W praktyce stworzenie przekonującego fałszywego połączenia wymaga obecnie mniej niż 20 minut i kosztuje poniżej jednego dolara.

Technologia AI, która umożliwia oszustom klonowanie głosu, ma też swoją jasną stronę – poznaj jak AI w telewizorach wpływa na codzienną rozrywkę i poprawia jakość oglądanych treści.

Najczęstsze scenariusze oszustw z wykorzystaniem AI

Oszuści wykorzystują sklonowane głosy w kilku charakterystycznych scenariuszach. Najpopularniejszy to współczesna wersja „telefonu od wnuczka”, gdzie przestępcy podszywają się pod członka rodziny w rzekomej sytuacji kryzysowej. Kolejnym popularnym wariantem są ataki na firmy, gdzie oszuści podszywają się pod dyrektorów lub menedżerów, polecając natychmiastowe przelewy.

Dla osób korzystających z oferty na kartę Play, szczególnie istotne jest zabezpieczenie własnego numeru telefonu. Ponieważ internet na kartę nie wymaga podpisania długoterminowej umowy, przestępcy często wykorzystują tę formę do wykonywania oszukańczych połączeń, które trudniej jest potem wyśledzić. Operator Play ma w swojej ofercie prepaid możliwość aktywacji dodatkowych zabezpieczeń, takich jak weryfikacja dwuskładnikowa czy blokada nieznanych numerów, co stanowi pierwszą linię obrony przed tego typu atakami.

Jak się bronić – praktyczne metody ochrony

Kluczową zasadą obrony przed oszustwami z wykorzystaniem AI jest zdrowy sceptycyzm połączony z konkretnymi procedurami weryfikacji. Eksperci ds. cyberbezpieczeństwa zalecają ustalenie z bliskimi tajnego hasła lub pytania, na które tylko rodzina zna odpowiedź. Jeśli rozmówca irytuje się, unika odpowiedzi lub zgaduje tajne hasło – to zdecydowany sygnał alarmowy. Nigdy nie należy reagować na prośby o pieniądze pod presją czasu, nawet jeśli głos brzmi znajomo. Zawsze warto przerwać połączenie i zweryfikować sytuację, dzwoniąc na znany wcześniej numer tej osoby lub kontaktując się innym kanałem komunikacji. Dodatkową ochroną jest ograniczenie ilości publicznie dostępnych nagrań własnego głosu w mediach społecznościowych.

Algorytmy klonowania głosu to tylko wierzchołek góry lodowej możliwości AI – sprawdź również przegląd darmowych programów AI do tworzenia grafik i poznaj pozytywne zastosowania tej samej technologii.

Przyszłość oszustw AI – co nas czeka

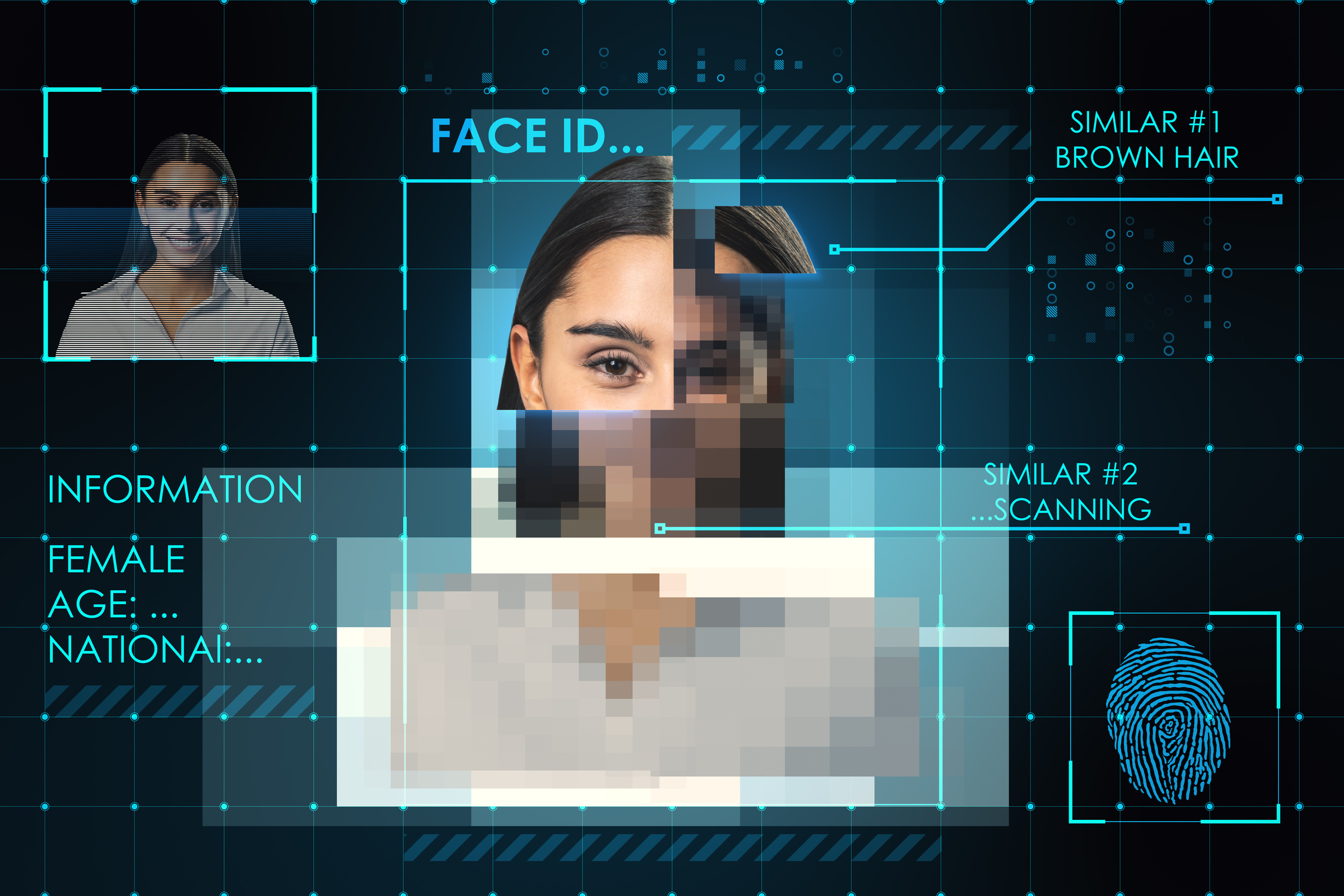

Prognozy na najbliższe lata nie są optymistyczne. Eksperci przewidują, że liczba oszustw głosowych wzrosła o 442% w 2025 roku w porównaniu do poprzedniego okresu, a technologia staje się coraz bardziej dostępna. Pojawiły się już systemy, które potrafią klonować głos wyłącznie na podstawie zdjęcia twarzy, analizując prawdopodobne cechy wokalne na podstawie rysów. Nowa technika FOICE potrafi wygenerować mowę z fotografii, oszacowując, jak dana osoba mogłaby brzmieć na podstawie wyglądu jej twarzy. To oznacza, że samo posiadanie publicznego profilu z fotografiami może wystarczyć do stworzenia przekonującego deepfake'u. Jednocześnie systemy wykrywania fałszywych nagrań pozostają daleko w tyle – ludzie poprawnie identyfikują wysokiej jakości deepfake'i wideo tylko w około 24,5% przypadków, a nawet zaawansowane narzędzia AI często zawodzą przy nowych metodach syntezy głosu.

Odpowiedzią na rosnące zagrożenie muszą być nie tylko lepsze technologie detekcji, ale przede wszystkim edukacja społeczna i świadome korzystanie z narzędzi cyfrowych. Dla użytkowników oferty na kartę Play, kluczowe jest regularne sprawdzanie ustawień bezpieczeństwa w aplikacji Play24 oraz unikanie udostępniania wrażliwych informacji przez telefon bez dodatkowej weryfikacji. Internet na kartę w sieci Play oferuje elastyczność i kontrolę nad wydatkami, ale wymaga również większej czujności ze strony użytkownika. W erze deepfake'ów i sklonowanych głosów, najważniejszą obroną pozostaje zdrowy rozsądek połączony z konkretnymi procedurami weryfikacji każdej podejrzanej sytuacji. Pamiętajmy – jeśli coś brzmi zbyt pilnie lub zbyt dobrze, by było prawdziwe, prawdopodobnie to oszustwo.